Uno de los LOS Neisseria principales objetivos de la investigación y los LOS Neisseria estudios médicos es aprender qué asociaciones o resultados no son producto del azar. Según el diseño del estudio y los LOS Neisseria datos que proporciona, se puede aceptar o rechazar una hipótesis, lo que permite determinar la correlación. Las pruebas estadísticas son herramientas utilizadas por los LOS Neisseria investigadores para obtener información y significado de conjuntos de datos variables. Estas pruebas se presentan en EN Erythema nodosum is an immune-mediated panniculitis (inflammation of the subcutaneous fat) caused by a type IV (delayed-type) hypersensitivity reaction. It commonly manifests in young women as tender, erythematous nodules on the shins. Erythema Nodosum varias formas, incluyendo, por ejemplo, las pruebas de chi-cuadrado y exacta de Fisher, y se eligen en EN Erythema nodosum is an immune-mediated panniculitis (inflammation of the subcutaneous fat) caused by a type IV (delayed-type) hypersensitivity reaction. It commonly manifests in young women as tender, erythematous nodules on the shins. Erythema Nodosum función de las necesidades de los LOS Neisseria investigadores y de las características de las variables analizadas. Los LOS Neisseria resultados del estudio pueden considerarse estadísticamente significativos en EN Erythema nodosum is an immune-mediated panniculitis (inflammation of the subcutaneous fat) caused by a type IV (delayed-type) hypersensitivity reaction. It commonly manifests in young women as tender, erythematous nodules on the shins. Erythema Nodosum función de los LOS Neisseria valores p calculados y los LOS Neisseria niveles de significancia predeterminados (conocidos como nivel α). Los LOS Neisseria intervalos de confianza son otra forma de expresar la importancia de un resultado estadístico sin utilizar un valor p.

Last updated: Dec 15, 2025

La comprobación de hipótesis se utiliza para evaluar la admisibilidad de una hipótesis mediante el análisis de los LOS Neisseria datos del estudio.

Por ejemplo, una empresa crea un nuevo medicamento X destinado a tratar la hipertensión. La empresa quiere saber si el medicamento X funciona realmente para reducir la presión arterial, por lo que tiene que hacer comprobación de hipótesis.

Pasos para comprobar una hipótesis:

Una hipótesis es una respuesta preliminar a una pregunta de investigación (i.e., una “suposición” sobre cuáles serán los LOS Neisseria resultados). Hay 2 tipos de hipótesis: la hipótesis nula y la hipótesis alternativa.

Ejemplo 1: rechazar la hipótesis nula

En EN Erythema nodosum is an immune-mediated panniculitis (inflammation of the subcutaneous fat) caused by a type IV (delayed-type) hypersensitivity reaction. It commonly manifests in young women as tender, erythematous nodules on the shins. Erythema Nodosum el ejemplo anterior, si los LOS Neisseria resultados del ensayo muestran que el medicamento X reduce significativamente la presión arterial (es decir, hay suficientes pruebas estadísticas que lo apoyan), se rechaza la hipótesis nula (que postula que no hay diferencias entre los LOS Neisseria grupos) con una probabilidad determinada. Obsérvese que estos resultados no pueden confirmar la hipótesis alternativa, sino que solo la apoyan con una probabilidad dada, determinada por la distribución del muestreo en EN Erythema nodosum is an immune-mediated panniculitis (inflammation of the subcutaneous fat) caused by a type IV (delayed-type) hypersensitivity reaction. It commonly manifests in young women as tender, erythematous nodules on the shins. Erythema Nodosum la población estudiada.

Ejemplo 2: no rechazar la hipótesis nula

En EN Erythema nodosum is an immune-mediated panniculitis (inflammation of the subcutaneous fat) caused by a type IV (delayed-type) hypersensitivity reaction. It commonly manifests in young women as tender, erythematous nodules on the shins. Erythema Nodosum el ejemplo anterior, si los LOS Neisseria resultados del ensayo muestran que el medicamento X no redujo significativamente la presión arterial, el estudio no rechazó la hipótesis nula. Una vez más, hay que tener en EN Erythema nodosum is an immune-mediated panniculitis (inflammation of the subcutaneous fat) caused by a type IV (delayed-type) hypersensitivity reaction. It commonly manifests in young women as tender, erythematous nodules on the shins. Erythema Nodosum cuenta que los LOS Neisseria resultados no pueden confirmar la hipótesis nula, sino que solo la apoyan con una probabilidad dada, determinada por la distribución del muestreo en EN Erythema nodosum is an immune-mediated panniculitis (inflammation of the subcutaneous fat) caused by a type IV (delayed-type) hypersensitivity reaction. It commonly manifests in young women as tender, erythematous nodules on the shins. Erythema Nodosum la población estudiada

La significancia estadística es la idea de que es muy poco probable que todos los LOS Neisseria resultados de las pruebas se produzcan simplemente por azar. Para determinar la significancia estadística, es necesario establecer un valor α y calcular un valor p.

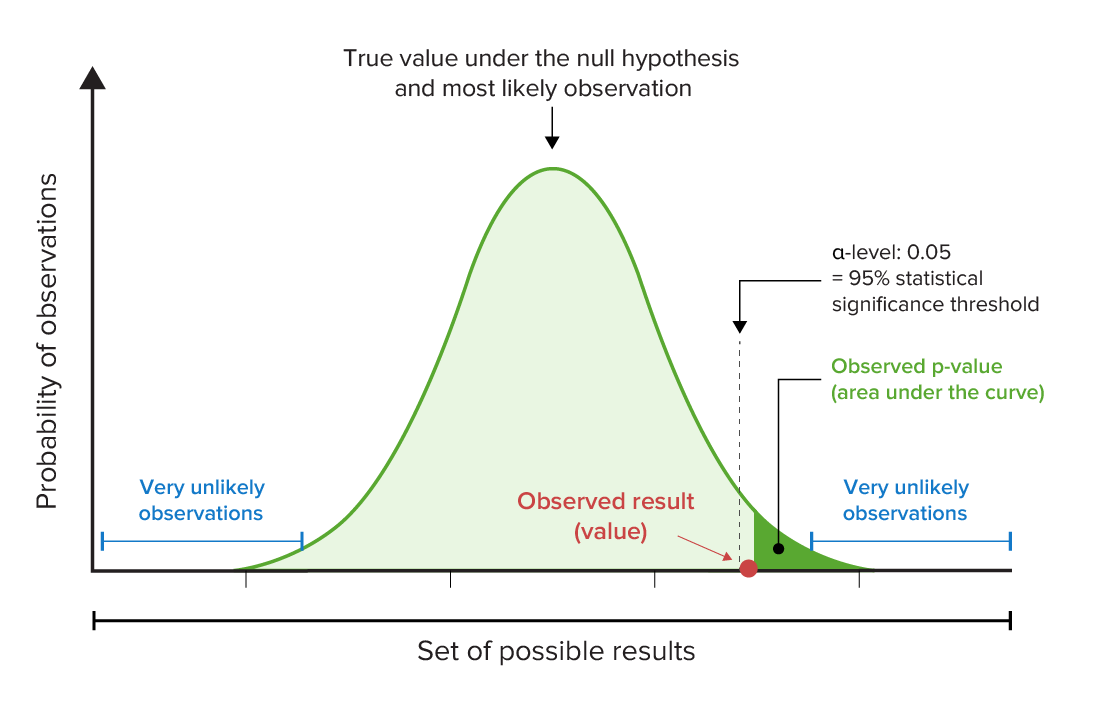

Se puede crear un gráfico en EN Erythema nodosum is an immune-mediated panniculitis (inflammation of the subcutaneous fat) caused by a type IV (delayed-type) hypersensitivity reaction. It commonly manifests in young women as tender, erythematous nodules on the shins. Erythema Nodosum el que los LOS Neisseria posibles resultados del estudio se representen en EN Erythema nodosum is an immune-mediated panniculitis (inflammation of the subcutaneous fat) caused by a type IV (delayed-type) hypersensitivity reaction. It commonly manifests in young women as tender, erythematous nodules on the shins. Erythema Nodosum el eje de las abscisas (x) y la probabilidad de observar cada resultado se represente en EN Erythema nodosum is an immune-mediated panniculitis (inflammation of the subcutaneous fat) caused by a type IV (delayed-type) hypersensitivity reaction. It commonly manifests in young women as tender, erythematous nodules on the shins. Erythema Nodosum el eje de las ordenadas (y). El área bajo la curva representa el valor p.

Mnemotecnia:

“Si la p es baja, la (hipótesis) nula no encaja”.

Representación gráfica del valor p y de los niveles α:

Observe, en este ejemplo, que el valor p observado es inferior al nivel de significancia estadística predeterminado (en este caso, el 95%). Esto significa que hay que rechazar la hipótesis nula porque el resultado observado sería muy improbable si la hipótesis nula (que no existe ninguna relación entre las variables) fuera cierta.

La elección de la prueba se basa en EN Erythema nodosum is an immune-mediated panniculitis (inflammation of the subcutaneous fat) caused by a type IV (delayed-type) hypersensitivity reaction. It commonly manifests in young women as tender, erythematous nodules on the shins. Erythema Nodosum:

Siempre hay que cuestionar la razonabilidad del modelo. Si el modelo es erróneo, también lo es todo lo demás.

Tenga cuidado con las variables que no son realmente independientes.

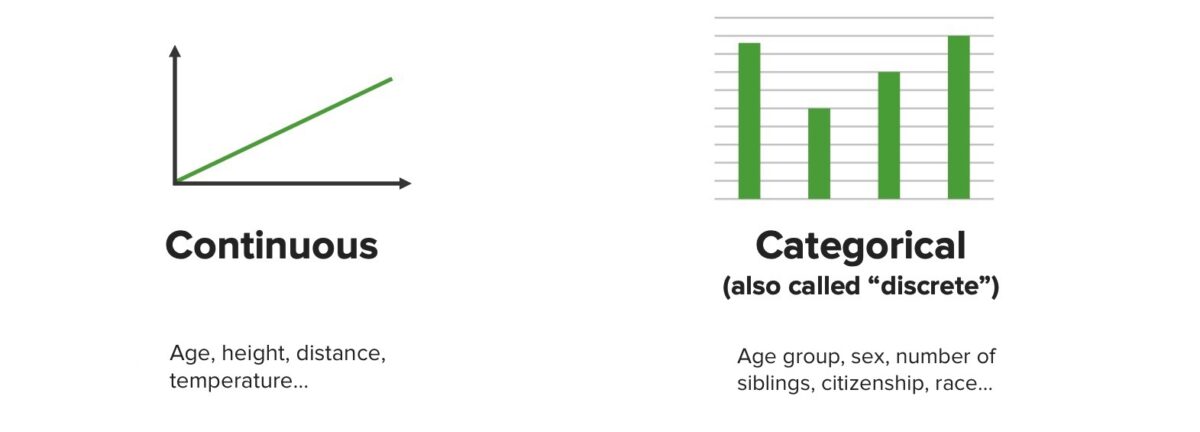

Representaciones gráficas de datos continuos y categóricos

Imagen por Lecturio. Licencia: CC BY-NC-SA 4.0Las 3 categorías principales de pruebas estadísticas son:

| Nombre de la prueba | Qué es lo que se comprueba en EN Erythema nodosum is an immune-mediated panniculitis (inflammation of the subcutaneous fat) caused by a type IV (delayed-type) hypersensitivity reaction. It commonly manifests in young women as tender, erythematous nodules on the shins. Erythema Nodosum la prueba | Tipos de variables/datos | Ejemplo |

|---|---|---|---|

| Pruebas de regresión | |||

| Regresión lineal simple | Cómo afecta un cambio en EN Erythema nodosum is an immune-mediated panniculitis (inflammation of the subcutaneous fat) caused by a type IV (delayed-type) hypersensitivity reaction. It commonly manifests in young women as tender, erythematous nodules on the shins. Erythema Nodosum la variable Variable Variables represent information about something that can change. The design of the measurement scales, or of the methods for obtaining information, will determine the data gathered and the characteristics of that data. As a result, a variable can be qualitative or quantitative, and may be further classified into subgroups. Types of Variables de predicción/entrada a la variable Variable Variables represent information about something that can change. The design of the measurement scales, or of the methods for obtaining information, will determine the data gathered and the characteristics of that data. As a result, a variable can be qualitative or quantitative, and may be further classified into subgroups. Types of Variables de resultado |

|

¿Cómo afecta el peso (predictor) a la esperanza de vida (resultado)? |

| Regresión lineal múltiple | Cómo los LOS Neisseria cambios en EN Erythema nodosum is an immune-mediated panniculitis (inflammation of the subcutaneous fat) caused by a type IV (delayed-type) hypersensitivity reaction. It commonly manifests in young women as tender, erythematous nodules on the shins. Erythema Nodosum las combinaciones de ≥ 2 variables predictoras pueden predecir los LOS Neisseria cambios en EN Erythema nodosum is an immune-mediated panniculitis (inflammation of the subcutaneous fat) caused by a type IV (delayed-type) hypersensitivity reaction. It commonly manifests in young women as tender, erythematous nodules on the shins. Erythema Nodosum el resultado |

|

¿Cómo afectan el peso y el nivel socioeconómico (predictores) a la esperanza de vida (resultado)? |

| Regresión logística | Cómo ≥ 1 variables predictoras pueden afectar a un resultado binario |

|

¿Cuál es el efecto del peso (predictor) sobre la supervivencia (resultado binario: vivo o muerto)? |

| Pruebas de comparación | |||

| Prueba t pareada | Compara las medias de 2 grupos de la misma población |

|

Comparar el peso de los LOS Neisseria bebés (resultado) antes y después de la alimentación (predictor). |

| Prueba t independiente | Compara las medias de 2 grupos de poblaciones diferentes |

|

¿Cuál es la diferencia de altura media (resultado) entre 2 equipos de baloncesto diferentes (predictor)? |

| Análisis de la varianza | Compara las medias de > 2 grupos |

|

¿Cuál es la diferencia en EN Erythema nodosum is an immune-mediated panniculitis (inflammation of the subcutaneous fat) caused by a type IV (delayed-type) hypersensitivity reaction. It commonly manifests in young women as tender, erythematous nodules on the shins. Erythema Nodosum los LOS Neisseria niveles de glucosa en EN Erythema nodosum is an immune-mediated panniculitis (inflammation of the subcutaneous fat) caused by a type IV (delayed-type) hypersensitivity reaction. It commonly manifests in young women as tender, erythematous nodules on the shins. Erythema Nodosum sangre (resultado) 1, 2 y 3 horas después de una comida (predictores)? |

| Pruebas de correlación | |||

| Prueba chi-cuadrado | Prueba la fuerza de la asociación entre 2 variables categóricas con un tamaño de muestra mayor |

|

Comparar si la aceptación en EN Erythema nodosum is an immune-mediated panniculitis (inflammation of the subcutaneous fat) caused by a type IV (delayed-type) hypersensitivity reaction. It commonly manifests in young women as tender, erythematous nodules on the shins. Erythema Nodosum la facultad de medicina ( variable Variable Variables represent information about something that can change. The design of the measurement scales, or of the methods for obtaining information, will determine the data gathered and the characteristics of that data. As a result, a variable can be qualitative or quantitative, and may be further classified into subgroups. Types of Variables 1) es más probable si el solicitante ha HA Hemolytic anemia (HA) is the term given to a large group of anemias that are caused by the premature destruction/hemolysis of circulating red blood cells (RBCs). Hemolysis can occur within (intravascular hemolysis) or outside the blood vessels (extravascular hemolysis). Hemolytic Anemia nacido en EN Erythema nodosum is an immune-mediated panniculitis (inflammation of the subcutaneous fat) caused by a type IV (delayed-type) hypersensitivity reaction. It commonly manifests in young women as tender, erythematous nodules on the shins. Erythema Nodosum el Reino Unido ( variable Variable Variables represent information about something that can change. The design of the measurement scales, or of the methods for obtaining information, will determine the data gathered and the characteristics of that data. As a result, a variable can be qualitative or quantitative, and may be further classified into subgroups. Types of Variables 2). |

| Prueba exacta de Fisher | Prueba la fuerza de la asociación entre 2 variables categóricas con un tamaño de muestra menor |

|

Igual que el chi-cuadrado, pero con tamaños de muestra más pequeños |

| Prueba r de Pearson | Prueba la fuerza de la asociación entre 2 variables continuas |

|

Comparar cómo el nivel de HbA1c en EN Erythema nodosum is an immune-mediated panniculitis (inflammation of the subcutaneous fat) caused by a type IV (delayed-type) hypersensitivity reaction. It commonly manifests in young women as tender, erythematous nodules on the shins. Erythema Nodosum plasma Plasma The residual portion of blood that is left after removal of blood cells by centrifugation without prior blood coagulation. Transfusion Products ( variable Variable Variables represent information about something that can change. The design of the measurement scales, or of the methods for obtaining information, will determine the data gathered and the characteristics of that data. As a result, a variable can be qualitative or quantitative, and may be further classified into subgroups. Types of Variables 1) está relacionado con los LOS Neisseria niveles de triglicéridos en EN Erythema nodosum is an immune-mediated panniculitis (inflammation of the subcutaneous fat) caused by a type IV (delayed-type) hypersensitivity reaction. It commonly manifests in young women as tender, erythematous nodules on the shins. Erythema Nodosum plasma Plasma The residual portion of blood that is left after removal of blood cells by centrifugation without prior blood coagulation. Transfusion Products ( variable Variable Variables represent information about something that can change. The design of the measurement scales, or of the methods for obtaining information, will determine the data gathered and the characteristics of that data. As a result, a variable can be qualitative or quantitative, and may be further classified into subgroups. Types of Variables 2) en EN Erythema nodosum is an immune-mediated panniculitis (inflammation of the subcutaneous fat) caused by a type IV (delayed-type) hypersensitivity reaction. It commonly manifests in young women as tender, erythematous nodules on the shins. Erythema Nodosum pacientes diabéticos. |

Las pruebas de chi-cuadrado se utilizan habitualmente para analizar datos categóricos y determinar si 2 variables categóricas están relacionadas.

Para realizar una prueba de chi-cuadrado, se necesitan 2 datos: los LOS Neisseria grados de libertad (número de categorías menos 1) y el nivel α (que elige el investigador y suele fijarse en EN Erythema nodosum is an immune-mediated panniculitis (inflammation of the subcutaneous fat) caused by a type IV (delayed-type) hypersensitivity reaction. It commonly manifests in young women as tender, erythematous nodules on the shins. Erythema Nodosum 0,05). Además, los LOS Neisseria datos deben organizarse en EN Erythema nodosum is an immune-mediated panniculitis (inflammation of the subcutaneous fat) caused by a type IV (delayed-type) hypersensitivity reaction. It commonly manifests in young women as tender, erythematous nodules on the shins. Erythema Nodosum una tabla.

Ejemplo: si se quiere ver si los LOS Neisseria malabaristas tienen más probabilidades de nacer durante una estación determinada, los LOS Neisseria datos podrían registrarse en EN Erythema nodosum is an immune-mediated panniculitis (inflammation of the subcutaneous fat) caused by a type IV (delayed-type) hypersensitivity reaction. It commonly manifests in young women as tender, erythematous nodules on the shins. Erythema Nodosum la siguiente tabla:

| Categoría (i): temporada de nacimiento | Frecuencia observada de malabaristas en EN Erythema nodosum is an immune-mediated panniculitis (inflammation of the subcutaneous fat) caused by a type IV (delayed-type) hypersensitivity reaction. It commonly manifests in young women as tender, erythematous nodules on the shins. Erythema Nodosum cada estación de nacimiento |

|---|---|

| Primavera | 66 |

| Verano | 82 |

| Otoño | 74 |

| Invierno | 78 |

Para empezar, hay que determinar las frecuencias esperadas para cada celda de la tabla anterior utilizando la ecuación:

$$ Frecuencia\ esperada = np_{0i} $$donde n = el tamaño de la muestra y p0i es la proporción hipotética en EN Erythema nodosum is an immune-mediated panniculitis (inflammation of the subcutaneous fat) caused by a type IV (delayed-type) hypersensitivity reaction. It commonly manifests in young women as tender, erythematous nodules on the shins. Erythema Nodosum cada categoría i.

En EN Erythema nodosum is an immune-mediated panniculitis (inflammation of the subcutaneous fat) caused by a type IV (delayed-type) hypersensitivity reaction. It commonly manifests in young women as tender, erythematous nodules on the shins. Erythema Nodosum el ejemplo anterior, n = 300 y p0i es ¼, por lo que la frecuencia de celdas esperada es de 300 * 0,25 = 75 en EN Erythema nodosum is an immune-mediated panniculitis (inflammation of the subcutaneous fat) caused by a type IV (delayed-type) hypersensitivity reaction. It commonly manifests in young women as tender, erythematous nodules on the shins. Erythema Nodosum cada celda.

La comprobación estadística se calcula entonces mediante la fórmula estándar de chi-cuadrado:

$$ \chi ^{2} = \sum _{all\ cells} \frac{(observada-esperada)^{2}}{esperada} $$donde 𝝌2 es la prueba estadística que se calcula. para cada “celda” o categoría, la frecuencia esperada se resta de la frecuencia observada; este valor se eleva al AL Amyloidosis cuadrado y luego se divide por la frecuencia esperada. Una vez calculada esta cifra para cada categoría, se suman los LOS Neisseria números.

Ejemplo de cálculo de 𝝌2: utilizando el ejemplo anterior, la frecuencia esperada en EN Erythema nodosum is an immune-mediated panniculitis (inflammation of the subcutaneous fat) caused by a type IV (delayed-type) hypersensitivity reaction. It commonly manifests in young women as tender, erythematous nodules on the shins. Erythema Nodosum cada celda es 75, por lo que el 𝝌2 puede calcularse como sigue:

| Categoría (i): temporada de nacimiento | Frecuencia observada de malabaristas con cada estación de nacimiento | (Observado – esperado)2/esperado |

|---|---|---|

| Primavera | 66 | (66 ‒ 75)2 / 75 = 1,08 |

| Verano | 82 | (82 ‒ 75)2 / 75 = 0,653 |

| Otoño | 74 | (74 ‒ 75)2 / 75 = 0,013 |

| Invierno | 78 | (78 ‒ 75)2 / 75 = 0,12 |

𝝌2= 1,08 + 0,653 + 0,013 + 0,12 = 1,866

Determinar si la prueba estadística es estadísticamente significativa o no:

Para determinar si esta prueba estadística es estadísticamente significativa, se utiliza la tabla de chi-cuadrado para obtener el número crítico de chi-cuadrado.

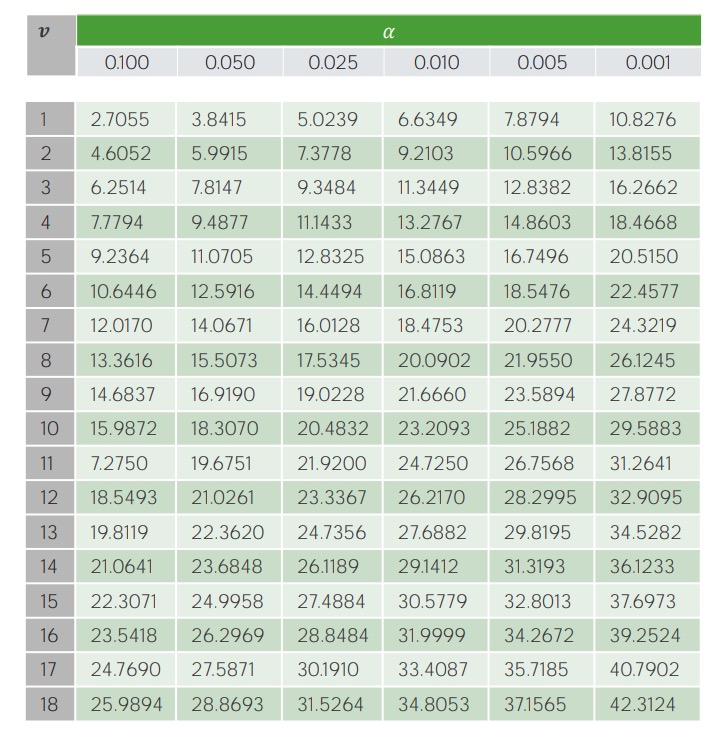

Ejemplo de la tabla de valores críticos para la prueba 𝝌2:

En el eje Y, V representa los grados de libertad (i.e., el número de categorías estudiadas menos 1); los niveles de significancia (niveles α) se muestran en el eje X. Los valores críticos correspondientes se encuentran en la tabla y se comparan con el resultado calculado de la prueba estadística.

Ejemplo de prueba 𝝌2: ¿Tienen los LOS Neisseria malabaristas más probabilidades de nacer en EN Erythema nodosum is an immune-mediated panniculitis (inflammation of the subcutaneous fat) caused by a type IV (delayed-type) hypersensitivity reaction. It commonly manifests in young women as tender, erythematous nodules on the shins. Erythema Nodosum una determinada estación del año a un nivel de significancia de 0,05?

| Categoría (i): temporada de nacimiento | Frecuencia observada de malabaristas con cada estación de nacimiento | (Observado – esperado)2/esperado |

|---|---|---|

| Primavera | 66 | (66 ‒ 75)2 / 75 = 1,08 |

| Verano | 82 | (82 ‒ 75)2 / 75 = 0,653 |

| Otoño | 74 | (74 ‒ 75)2 / 75 = 0,013 |

| Invierno | 78 | (78 ‒ 75)2 / 75 = 0,12 |

𝝌2= 1,08 + 0,653 + 0,013 + 0,12 = 1,866

Como 1,866 es < 7,81 (nuestro valor crítico), tenemos que no rechazar (i.e., aceptar) la hipótesis nula y concluir que la estación de nacimiento no está asociada con el nacimiento de malabaristas.

Errores comunes:

Similar a la prueba 𝝌2, la prueba exacta de Fisher es una prueba estadística utilizada para determinar si existen asociaciones no aleatorias entre 2 variables categóricas.

Una tabla de contingencia 2 × 2 se establece así:

| Y | Z | Total de filas | |

|---|---|---|---|

| W | A | B | A + B |

| X | C | D | C + D |

| Total de la columna | A + C | B + D | A + B + C + D (= n) |

El resultado de la prueba estadística, p, se calcula a partir de esta tabla mediante la siguiente fórmula:

$$ p = \frac{(\frac{a+b}{a})(\frac{c+d}{c})}{(\frac{n}{a+c})} = \frac{(\frac{a+b}{b})(\frac{c+d}{d})}{(\frac{n}{b+d})} = \frac{(a+b)! (c+d)! (a+c)! (b+d)!}{a! b! c! d! n!} $$donde p = valor p; A, B, C y D son números de las celdas de una tabla de contingencia básica de 2 × 2; y n = total de A + B + C + D.

Antes de realizar cualquier cálculo, los LOS Neisseria datos deben presentarse en EN Erythema nodosum is an immune-mediated panniculitis (inflammation of the subcutaneous fat) caused by a type IV (delayed-type) hypersensitivity reaction. It commonly manifests in young women as tender, erythematous nodules on the shins. Erythema Nodosum un formato gráfico sencillo (e.g., gráfico de barras, diagrama de dispersión, histograma).

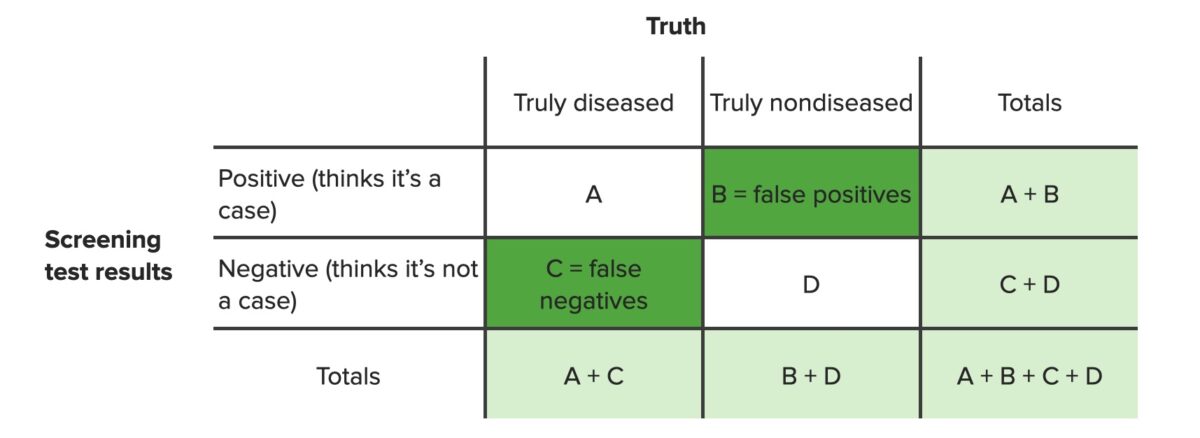

Tablas de contingencia:

Tabla de contingencia que identifica los falsos positivos (b) y los falsos negativos (c)

Imagen por Lecturio. Licencia: CC BY-NC-SA 4.0Diagramas de dispersión:

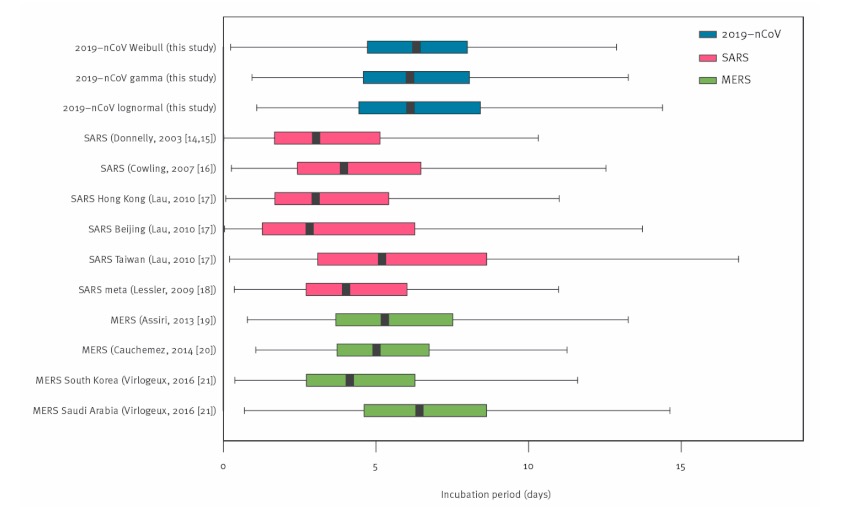

Gráficos de cuadros:

Ejemplo de gráfico de cuadros

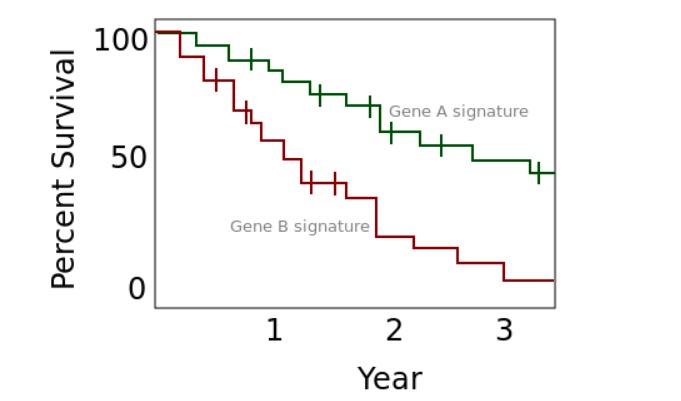

Imagen: “Box-and-whisker-plots” por Jantien A. Backer, Don Klinkenberg, Jacco Wallinga. Licencia: CC BY 4.0Curvas de supervivencia de Kaplan-Meier

Ejemplo de gráfico de Kaplan-Meier

Imagen: “An example of a Kaplan Meier plot” por Rw251. Licencia: CC0 1.0Tablas (una tabla de frecuencias es 1 ejemplo):

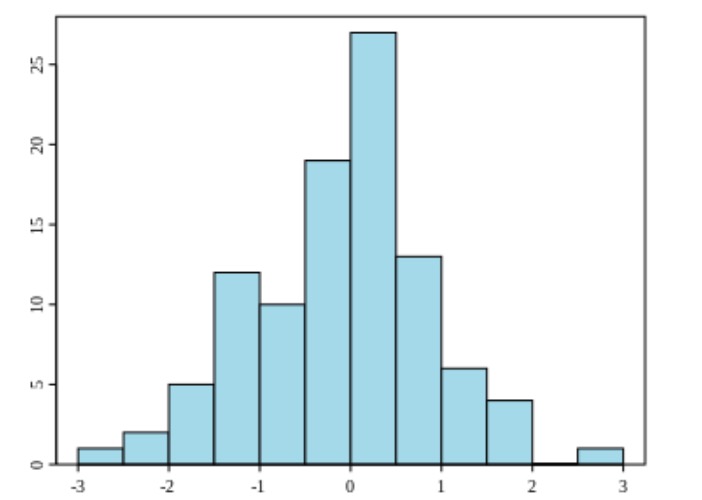

Histogramas:

Ejemplo de histograma

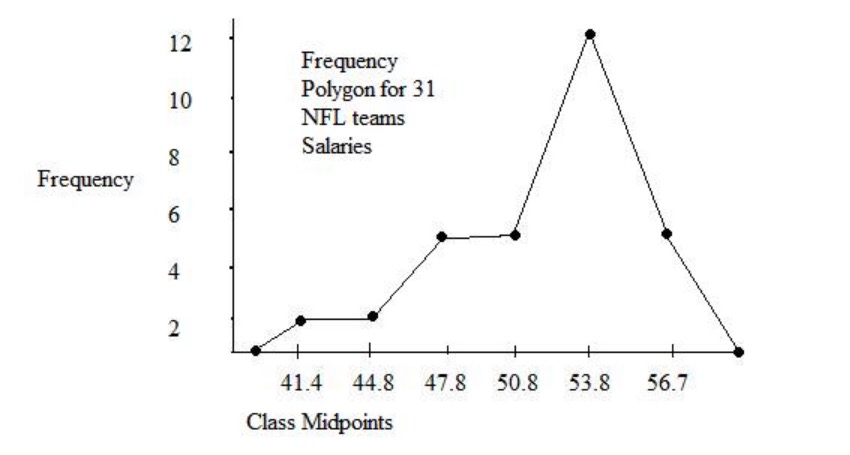

Imagen: “Example of a histogram” por Jkv. Licencia: Dominio PúblicoGráficos de polígonos de frecuencia:

Gráfico de polígonos de frecuencia para los salarios de 31 equipos de la Liga de Fútbol Nacional (NFL, por sus siglas en inglés)

Imagen: “Example of a frequency polygon chart” por JLW87. Licencia: Dominio PúblicoLas tablas de frecuencia, los LOS Neisseria gráficos de barras/histogramas y los LOS Neisseria gráficos circulares son tres de las formas más comunes de presentar datos categóricos.

Tablas de frecuencia:

| Color del semáforo | Frecuencia |

|---|---|

| Rojo | 65 |

| Amarillo | 5 |

| Verde | 30 |

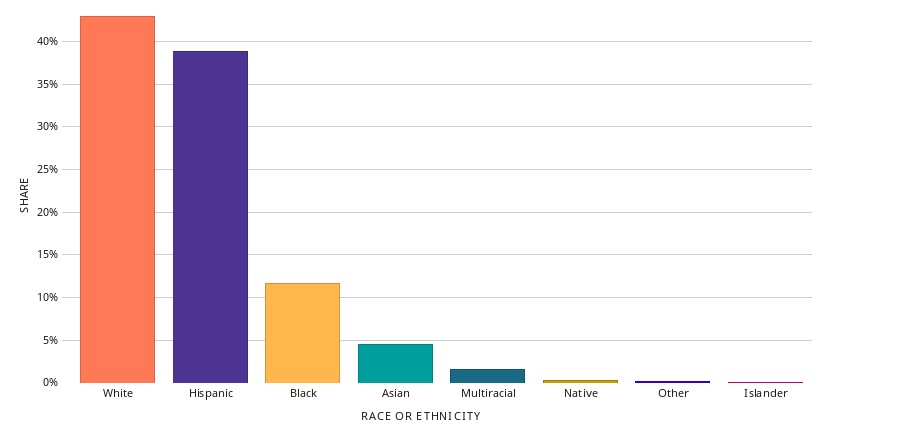

Gráfico de barras:

Ejemplo de gráfico de barras

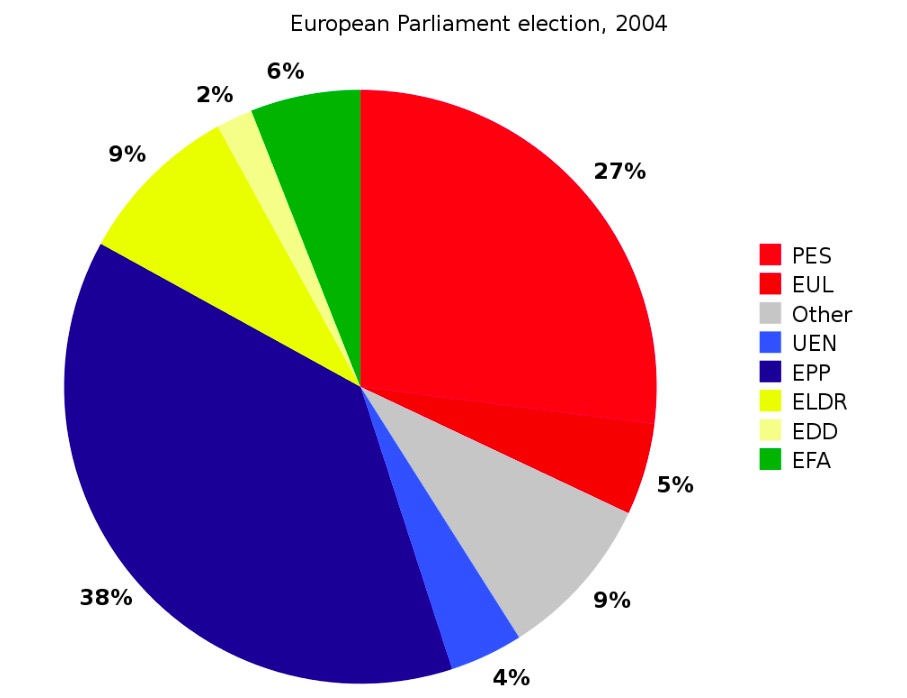

Imagen: “Bar Chart of Race & Ethnicity in Texas” por Datawheel. Licencia: CC0 1.0Gráficos circulares:

Ejemplo de gráfico circular

Imagen: “A pie chart for the example data” por Liftarn. Licencia: Dominio Público